Każda potężna technologia niesie ze sobą ryzyko niewłaściwego użycia – nie inaczej jest z generatywną AI. Tworzenie realistycznych treści przez algorytmy rodzi pytania o granice etyczne: jak zapobiec dezinformacji, kto odpowiada za treści generowane przez AI, jak chronić własność intelektualną i prywatność? W tym artykule omawiamy kluczowe pytania o etyczność GenAI.

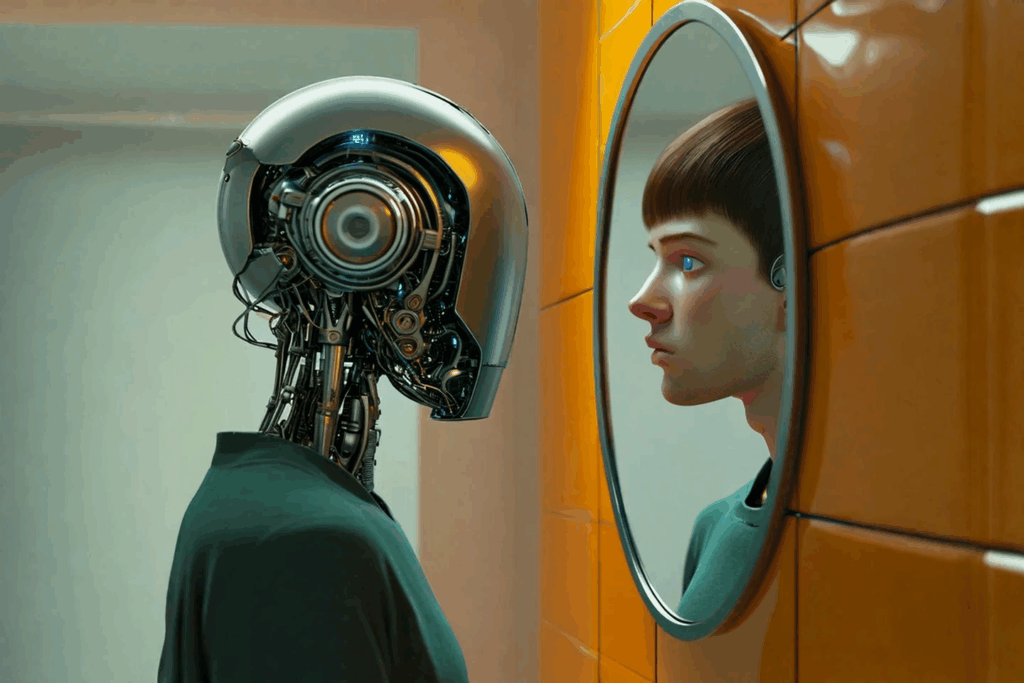

Dezinformacja i deepfake. Gdy nie wierzysz własnym oczom i uszom

Jednym z największych zagrożeń GenAI jest możliwość tworzenia przekonująco wyglądających fałszywych treści. Technologia deepfake w wideo i audio pozwala na podmienianie w prawdziwych nagraniach wizerunków (ruch, mimika) i głosów ludzi. W złych rękach (grup propagandowych i przestępców) może posłużyć na przykład do tworzenia filmów, na których polityk wygłasza nieprawdziwe oświadczenia, a celebryta robi coś, co nigdy nie miało miejsca.

Takie materiały mogą wywołać zamieszanie społeczne lub zniszczyć reputację. Już w 2023 roku świat obiegły przykłady deepfake’ów – jak fałszywe nagranie rzekomej eksplozji w okolicach Pentagonu, które na chwilę zachwiało rynkami, zanim zdementowano je jako falsyfikat generowany przez AI.

Fałszywe artykuły i posty w sieci

Modele językowe potrafią pisać przekonujące teksty, co niestety oznacza możliwość automatyzacji produkcji fake newsów, spamu, manipulacyjnych wpisów w mediach społecznościowych. Armie botów zasilane GenAI mogą zalewać internet dezinformacją trudną do odróżnienia od prawdziwych przekazów. Szczególnie niebezpieczne jest to w kontekście wyborów czy kryzysów. Nietrudno wyobrazić sobie tysiące spreparowanych artykułów podszywających się pod wiarygodne źródła, szerzących panikę lub nienawiść.

Phishing i oszustwa na wyższym poziomie

Scammerzy już teraz wykorzystują AI do generowania spersonalizowanych wiadomości phishingowych, pisanych płynnym językiem i przekonujących ofiarę, że to autentyczny e‑mail od znajomego, współpracownika czy banku. Dzięki klonowaniu głosu zdarzają się też oszustwa telefoniczne, w której ofiara słyszy głos bliskiej osoby proszącej o pilną pomoc finansową, podczas gdy to przestępca odtwarza syntetyczny głos przez telefon. Co gorsza, taki automat jest w stanie prowadzić rozmowę także w czasie rzeczywistym.

Zagrożenia te sprawiają, że rośnie rola cyfrowej edukacji i rozwijania narzędzi do wykrywania deepfake’ów. Już teraz badacze pracują nad metodami znakowania treści generowanych (choćby wprowadzania niewidocznych dla oka znaczników wodnych do obrazów AI czy stylometrycznego rozpoznawania tekstów pisanych przez model). Wielkie platformy internetowe również deklarują zaostrzenie polityk zakazujących publikacji deepfake’ów, które wprowadzają w błąd opinię publiczną. Niemniej jednal nadążenie za skalą i tempem generowania fałszywek będzie wkrótce ogromnym wyzwaniem.

Stronniczość i szkodliwe treści – AI uczy się także złych wzorców

Modele GenAI chłoną ogromne ilości danych z internetu, a w nich niestety roją się także uprzedzenia, nienawiść czy nieprawdziwe informacje. W efekcie otrzymać możemy:

Bias (stronniczość) w odpowiedziach

Jeżeli dane treningowe nadreprezentują pewne stereotypy (na przykład o mniejszościach), model może je nieświadomie powielać. Były przypadki, gdy AI generowała treści rasistowskie, seksistowskie czy dyskryminujące po prostu dlatego, że w internecie pełno jest takich toksycznych wypowiedzi i model uznał je za „normalne”. To duży problem etyczny: jak zapewnić, że algorytm będzie traktował wszystkich użytkowników sprawiedliwie i z szacunkiem? Firmy starają się filtrami i dodatkowymi treningami wyrugować takie tendencje, ale całkowite wyeliminowanie uprzedzeń z algorytmu jest bardzo trudne (wszyscy mamy jakieś nieuświadomione uprzedzenia, a co dopiero AI ucząca się na ludzkich tekstach).

Generowanie szkodliwych treści

Jeśli prywatny użytkownik zdecyduje się poprosić model o stworzenie czegoś niebezpiecznego, na przykład instrukcji skonstruowania broni czy wirusa komputerowego, AI nie powinna być w stanie tego zrobić. Tak samo kiedy ktoś będzie próbował szerzyć mowę nienawiści czy wzywać do przemocy, również w takich przypadkach użytkownik AI powinien spotkać się z odmową. Jednak wbudowanie granic moralnych w systemy AI to spore wyzwanie. Najwięksi dostawcy (OpenAI, Google) wdrożyli całe systemy moderacji: modele zostały nauczone odmawiać przy takich zapytaniach, a nadto czuwają nad tym filtry monitorujące treści wyjściowe. Niemniej jednak pojawiają się luki.

Sprytni użytkownicy próbują „oszukać” AI, by ominęła ograniczenia (tzw. prompt hacking). Wyścig między zabezpieczeniami a próbami ich obejścia będzie stawał się coraz intensywniejszy.

Prawa autorskie i własność intelektualna

Generatywna AI stawia też wiele pytań z zakresu regulacji. Czy AI może naruszać cudze prawa? Modele trenowane są na istniejących utworach – obrazach, tekstach, muzyce – często bez zgody twórców. Gdy AI generuje obraz „w stylu Picassa” albo utwór brzmiący jak piosenka Drake’a, czy narusza to prawa autorskie oryginałów? Na razie brak jednoznacznych regulacji. Trwają już procesy sądowe (w tym artystów pozywających firmę stojącą za Stable Diffusion za wykorzystywanie ich prac w treningu).

Pojawiają się pomysły, by twórcy mieli prawo opt-out, czyli zażądać, aby ich dzieła nie mogły być wykorzystywane do trenowania AI, albo by otrzymywali wynagrodzenie, jeśli model nauczył się generować treści na podstawie ich stylu.

Kto jest autorem dzieła stworzonego przez AI?

Jeśli grafik wygenerował ilustrację przez Midjourney i wykorzystał ją w komercyjnym projekcie, czy należy mu się pełnia praw autorskich do tej ilustracji? Obecnie w wielu krajach utwory stworzone w pełni przez AI nie są chronione prawem autorskim (bo nie mają ludzkiego autora). Dlatego firmy muszą ostrożnie podchodzić do wykorzystania takich treści. Paradoksalnie może się okazać, że obraz wygenerowany przez AI jest w stanie legalnie skopiować konkurencja. Zaleceniem prawników jest, by traktować generatywne materiały jako materiały referencyjne i zawsze wprowadzać twórczą pracę człowieka w finalny efekt (by móc rościć sobie prawa autorskie do całości).

Plagiat i wiarygodność źródeł

Ponieważ AI generuje teksty na podstawie istniejących, zdarza się, że ich fragmenty są bardzo podobne do oryginalnych prac, szczególnie jeśli model nauczył się jakiegoś często powtarzanego sformułowania czy cytatu. To rodzi ryzyko popełnienia nieświadomego plagiatu. Ponadto modele często nie podają źródeł informacji (chyba że są specjalnie do tego dostosowane), co utrudnia weryfikację faktów.

Tworzenie prac naukowych z pomocą AI bez odpowiedniego cytowania może prowadzić do naruszeń standardów rzetelności i konsekwencji prawnych.

Odpowiedzialność i regulacje – kto trzyma ster?

Kwestia odpowiedzialności za AI jest złożona. W grę wchodzi:

Odpowiedzialność twórców technologii

Czy firma tworząca model (np. OpenAI) ponosi odpowiedzialność, jeśli ktoś wykorzysta go do popełnienia przestępstwa lub jeśli model wygeneruje treści naruszające prawo? Praktyka pokazuje, że dostawcy starają się kontraktowo przerzucić odpowiedzialność na użytkowników (w regulaminie pojawia się zakaz wykorzystywania AI do nielegalnych celów). Jednak presja społeczna i potencjalne regulacje mogą wymusić większą kontrolę, w tym obowiązek wdrażania zabezpieczeń i audytów pod kątem uprzedzeń czy zgłaszania poważnych incydentów. Już teraz w Unii Europejskiej obowiązuje AI Act, czyli Rozporządzenie (UE) 2024/1689, które weszło w życie 2 sierpnia 2024 roku. Ma ono zobowiązać twórców generatywnej AI do oznaczania generowanych treści (by ułatwić ich identyfikację) oraz do oceniania ryzyka związanego z ich produktami przed wprowadzeniem na rynek.

Odpowiedzialność użytkowników i firm korzystających z AI

Jeżeli firma użyje GenAI do wygenerowania kampanii marketingowej i ta kampania kogoś zniesławi lub wprowadzi w błąd, firma nie wymiga się tłumaczeniem, że „to AI tak zrobiła”. Trzeba traktować outputy generatywne jak prace podwykonawcy: sprawdzać je, korygować i brać za nie odpowiedzialność prawną.

Dlatego wiele organizacji wprowadza wewnętrzne wytyczne korzystania z AI, na przykład wymaganie zatwierdzenia przez prawnika, zakaz wykorzystywania poufnych danych w zapytaniach do publicznych modeli (to także kwestia prywatności), obowiązek informowania klientów, gdy komunikują się z botem, a nie człowiekiem i inne.

Przejrzystość i zaufanie

Etycznym obowiązkiem staje się też transparentne informowanie, kiedy treść jest dziełem AI. Coraz częściej postulowane jest oznaczanie tekstów AI w mediach czy dodawanie znaczników do generowanych obrazów. Uczciwość wobec odbiorców wymaga, by nie zacierać granicy między ludzkim a syntetycznym. Dzięki temu łatwiej będzie zachować zaufanie. Społeczeństwo ma prawo wiedzieć, czy czyta artykuł napisany przez dziennikarza, czy wygenerowany przez model, i czy rozmawia przez telefon z konsultantem, czy z AI.

Etyczność GenAI — podsumowanie

Etyczne wyzwania generatywnej AI są poważne i wielowymiarowe. Od walki z dezinformacją i zapobieganiem nadużyciom (jak deepfake), przez ograniczanie stronniczości i mowy nienawiści w odpowiedziach modeli, aż po uregulowanie kwestii praw autorskich i odpowiedzialności za treści – to wszystko wymaga wspólnego wysiłku firm technologicznych, regulatorów i społeczeństwa.

GenAI oferuje ogromne korzyści, ale żeby je bezpiecznie czerpać, musimy wypracować zasady odpowiedzialnego korzystania. Każda firma wdrażająca AI powinna zadać sobie pytanie: czy używamy tej technologii w sposób uczciwy, przejrzysty i bezpieczny dla naszych klientów i otoczenia? Tylko wtedy generatywna sztuczna inteligencja będzie służyć jako pozytywne narzędzie, a nie źródło nowych problemów.

Czym jest etyka sztucznej inteligencji?

Etyka AI to zbiór zasad i wartości, które mają na celu zapewnienie, że systemy oparte na sztucznej inteligencji działają w sposób odpowiedzialny, sprawiedliwy i transparentny. Dotyczy to m.in. prywatności, niedyskryminacji i odpowiedzialności za decyzje podejmowane przez AI.

Jakie są największe zagrożenia etyczne związane z GenAI?

Do największych zagrożeń należą: generowanie dezinformacji, utrwalanie uprzedzeń, brak transparentności decyzji, trudności z przypisaniem odpowiedzialności oraz wykorzystywanie AI do manipulacji emocjonalnej lub ekonomicznej użytkowników.

W jaki sposób GenAI może być wykorzystywana nieetycznie?

GenAI może być używana do tworzenia deepfake’ów, fałszywych opinii, automatycznego profilowania użytkowników czy targetowania osób podatnych na manipulację. W rękach nieodpowiedzialnych podmiotów może prowadzić do szkód społecznych, reputacyjnych i psychologicznych.

Jak firmy mogą zadbać o etyczne wykorzystanie GenAI?

Organizacje powinny wdrażać zasady odpowiedzialnego rozwoju AI, monitorować dane uczące, zapewniać audyty algorytmów oraz jasno informować użytkowników, kiedy mają do czynienia z generowaną treścią. Ważna jest też edukacja zespołów i uwzględnianie perspektywy użytkowników.

Czy istnieją regulacje prawne dotyczące GenAI i etyki?

Tak, coraz więcej państw i organizacji wdraża regulacje dotyczące GenAI. Przykładem jest unijna AI Act, która klasyfikuje ryzyka i narzuca obowiązki w zakresie transparentności, nadzoru i ochrony praw użytkowników. Jednak prawo często nie nadąża za tempem rozwoju technologii.